- within Technology topic(s)

- within Technology, Wealth Management and Employment and HR topic(s)

- with Senior Company Executives, HR and Inhouse Counsel

Continuamos con nuestro análisis del segundo bloque de Guías Técnicas Especializadas (Guías 3 a 15) de la Agencia Española de Supervisión de la Inteligencia Artificial (AESIA) para el cumplimiento del Reglamento Europeo de Inteligencia Artificial (RIA).

En concreto, hoy analizamos los puntos clave de las Guías núm. 5 y 6 de la AESIA:

Guía 5: "Gestión de riesgos"

La Guía 5, titulada "Gestión de riesgos", desarrolla operativamente el cumplimiento del artículo 9 del RIA bajo la rúbrica "Sistema de gestión de riesgos". Este artículo establece la obligación de implementar un proceso iterativo y continuo durante todo el ciclo de vida de los sistemas de IA de alto riesgo para identificar y mitigar peligros potenciales. La responsabilidad de cumplir con esta obligación recae principalmente en el proveedor como encargado del desarrollo del sistema. No obstante, la Guía 5 aclara que, si un responsable del despliegue participa en el desarrollo del sistema, este deberá aplicar las medidas desarrolladas por el proveedor. El foco de este sistema debe ser la protección de la salud, la seguridad y a los derechos fundamentales de las personas.

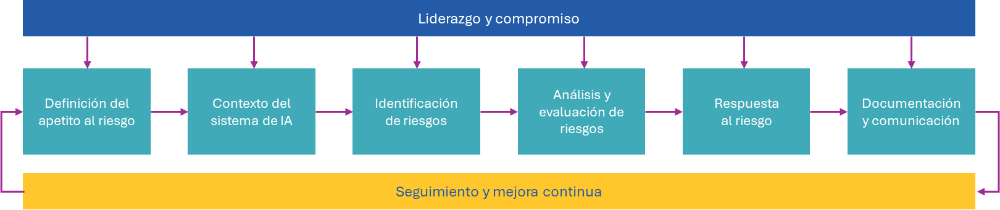

Para desarrollar un sistema de gestión de riesgos adecuado, la Guía 5 detalla un itinerario compuesto por ocho fases interconectadas.

Un punto clave de la guía es la determinación del apetito al riesgo, que se define como el volumen de riesgo que la organización tolera para lograr su misión. Esta valoración se realiza de forma cuantitativa mediante una escala de niveles (e.g. del 1 al 15). Si un sistema tiene un impacto crítico, como la administración de insulina en el ámbito médico, el apetito al riesgo debe ser muy bajo; por el contrario, en sistemas de bajo impacto como la recomendación de películas basada en gustos, la tolerancia puede ser mucho mayor.

Por último, la guía advierte sobre peligros críticos como la discriminación algorítmica y el impacto negativo de los sistemas biométricos. Utilizando casos de estudio, se ilustra cómo sesgos en los datos pueden penalizar injustamente a colectivos por raza o género en el acceso a la salud o el empleo.

Guía 6: "Supervisión Humana"

La Guía 6, titulada "Supervisión Humana", se centra en el desarrollo operativo de las obligaciones establecidas en el artículo 14 del RIA. Su objetivo principal es garantizar que los sistemas de IA de alto riesgo estén diseñados de tal manera que puedan ser vigilados de forma efectiva por personas físicas durante su uso.

La supervisión humana no es solo un requisito técnico, sino un mecanismo de gobernanza para evitar que la IA socave la autonomía humana o provoque daños a la salud, la seguridad o los derechos fundamentales. La guía subraya que el control humano permite la rendición de cuentas por las acciones del sistema. En concreto, para que el humano entienda realmente el funcionamiento del sistema, la guía establece una serie de medidas que el diseño debe incorporar, incluyendo, entre otras:

- "Contrafactualidad": El sistema no debe limitarse a explicar por qué tomó una decisión, sino también detallar qué cambios en los datos de entrada habrían variado el resultado. Esto es esencial para que un supervisor o un afectado comprendan, por ejemplo, bajo qué condiciones se habría aceptado una solicitud denegada.

- Desglose jerárquico: La interfaz debe permitir navegar por la información de manera estructurada, desde lo más global (el mecanismo de razonamiento general del modelo) hasta lo más particular (la lógica detrás de una decisión individual concreta).

Asimismo, la guía explica los tres enfoques fundamentales para calibrar cuánta autonomía se le otorga al sistema:

- Human-in-the-loop (HITL): El humano interviene en cada ciclo de decisión. Es el nivel recomendado para casos de alto riesgo donde cada acción debe ser validada individualmente.

- Human-on-the-loop (HOTL): La vigilancia se realiza a posteriori o durante el funcionamiento, permitiendo la intervención si se detecta una anomalía.

- Human-in-command (HIC): El ser humano mantiene el mando global y la responsabilidad última sobre las decisiones críticas y el funcionamiento seguro del sistema.

Un punto importante es el énfasis en la necesidad de interfaces adecuadas. El proveedor debe facilitar al responsable del despliegue herramientas que permitan interpretar los resultados y los razonamientos de la IA de forma sencilla, visual y en lenguaje natural.

Por último, la guía aborda un riesgo psicológico crítico: la tendencia humana a confiar ciegamente en las decisiones de la máquina. Para combatirlo, propone medidas como implementar un modo de "error forzado", es decir, introducir fallos deliberados en entornos de prueba para testar si el supervisor mantiene su criterio crítico y garantizar la concienciación mediante la formación de los supervisores para que entiendan las limitaciones y fallos típicos del sistema

The content of this article is intended to provide a general guide to the subject matter. Specialist advice should be sought about your specific circumstances.