- within Technology topic(s)

- in Canada

- with readers working within the Banking & Credit and Business & Consumer Services industries

- within Technology topic(s)

- with readers working within the Business & Consumer Services industries

- within Technology, Strategy and Transport topic(s)

本文为"China's Key Developments in Artificial Intelligence Governance in 2025"的中文版本,点击题目链接可获取英文原文。

引 言

过去一年,中国人工智能产业发展迅猛。年初,DeepSeek R1的发布引发广泛关注,其优异的推理能力与极具性价比的训练成本震撼了全球市场,标志着国产大模型在全球技术竞争中实现了突破。此后,DeepSeek、Kimi、阿里、字节、MiniMax等企业持续迭代技术能力,推动模型规模、多模态能力和训练效率不断跃升,部分关键指标已接近或达到国际领先水平。与此同时,生成式人工智能也正迅速深入中国的各行各业,广泛应用于搜索引擎、办公协作、在线教育等多个领域。

在产业技术高歌猛进的同时,中国的人工智能监管体系也进入了"从原则确立到机制落地"的关键阶段。2025年10月28日新修订的《网络安全法》也针对"人工智能合规"增加了一条单独的条款,强调中国支持人工智能技术的发展,但同时也非常重视人工智能伦理、风险监测评估等安全问题。去年在《中国人工智能法立法指南》(Guide to Chinese Artificial Intelligence Legislation)一文中,我们围绕着《互联网信息服务算法推荐管理规定》(以下简称"《算法推荐规定》")、《互联网信息服务深度合成管理规定》(以下简称"《深度合成规定》")和《生成式人工智能服务管理暂行办法》(以下简称"《AIGC管理办法》")梳理了人工智能领域的基本合规框架。本篇将结合今年的立法进展与监管趋势,进一步探讨中国人工智能治理体系的最新动向。

一、2025:中国AI治理的关键进展

(一)制度建设持续完善

- 内容标识

为了提升信息透明度,防范人工智能生成内容被滥用,各国监管机构都在探索建立人工智能生成合成内容标识制度。例如,欧盟《人工智能法案》(EU AI Act)第50条第2款明确规定,提供生成音频、图像、视频或文本内容的人工智能系统的提供者,应确保其输出内容以机器可读格式进行标识,并可被检测为"由人工生成或操纵";美国亦有类似探索,加州先后通过了SB 942和AB 853两部《人工智能透明法案》(Artificial Intelligence Transparency Act),针对每月活跃用户或访问量超过100万的生成式人工智能系统提供者(Generative AI System Provider)、大型在线平台(Large Online Platform)及采集设备制造商(Capture Device Manufacturer),设立了内容标识义务。其中,生成式人工智能系统提供者必须在图像、音频、视频等生成内容的元数据或不可见层中嵌入隐性披露(Latent Disclosure),并向用户免费提供可识别该标识的AI检测工具(AI Detection Tool),以便实现内容溯源和机器端验证;平台运营方亦应保留并公开披露相关内容的可检测元数据。

这一监管趋势在中国也得到了制度化的回应。早在2023年8月,全国网络安全标准化技术委员会(TC260)制定了《网络安全标准实践指南——生成式人工智能服务内容标识方法》,为内容标识义务的具体要求提供了初步指引。而在2025年3月,网信办发布了《人工智能生成合成内容标识办法》(以下简称"《内容标识办法》")。该办法要求网络信息服务提供者需要在人工智能生成的内容上添加"显式标识"(如标注"内容由AI生成"的水印),并在文件的元数据中添加"隐式标识"。此外,监管机构还陆续发布了多项国家标准和实践指南,从技术实践角度为服务提供者履行内容标识义务提供了范例与参考。

随着《内容标识办法》在2025年9月1日正式施行,中国各主流的人工智能平台均落地并公开了其人工智能内容标识的措施。 1此外,上海市网信办还指导成立了人工智能生成合成内容标识生态联盟,推动了30余家企业开展隐式标识互认验证。 2

- 未成年人保护

近年来,未成年人保护已成为各国在人工智能领域重点监管方向之一。例如,欧盟委员会于2025年7月发布了"Guidelines on protection of minors online under the DSA"3,指导在线平台在合理确定用户为未成年人时,不得基于其个人数据对其进行画像分析并向其展示个性化广告。与此同时,美国联邦贸易委员会近期也就儿童保护问题对若干运营人工智能聊天机器人的企业展开了调查。 4

中国政府也在2025年发布了多项保护未成年人的措施,比如教育部于2025年5月发布《中小学生生成式人工智能使用指南(2025年版)》 5,首次明确了生成式人工智能在基础教育阶段的分级使用规范。与此同时,行业组织也积极推动人工智能安全治理体系建设。中国网络空间安全协会发布了团体标准《网络安全技术 向未成年人提供生成式人工智能服务安全指引(征求意见稿)》,并协同各行业单位发布了《人工智能服务未成年人伦理规范共识》 6,提出"最有利于未成年人"原则,倡导从健康优先、隐私守护、内容保障等七个维度建立行业伦理共识。

这些举措系统强化了人工智能应用场景中对未成年人的安全与伦理保障,旨在为未成年人在人工智能时代的安全成长提供多层次制度保障。

- 安全事件应急处置

在安全治理体系方面,中国正加快完善网络与人工智能领域的应急处置机制。2025年9月,网信办发布《国家网络安全事件报告管理办法》,进一步细化了安全事件报告的相关时限要求。根据该办法,除关键信息基础设施运营者及中央和国家机关等单位外,其他网络运营者在发现或获知较大级别的网络安全事件后,应当在四小时内向所在地省级网信部门报告,以确保突发事件能得到快速响应与处置。

在生成式人工智能服务领域,TC260于9月发布的《网络安全标准实践指南——生成式人工智能服务安全应急响应指南》(以下简称"《应急响应指南》")则提供了更具针对性的操作性参考。该《应急响应指南》根据安全事件的影响对象、业务损失及社会危害程度将其划分为特别重大、重大、较大和一般四个等级。对于被认定为严重违反社会主义核心价值观、大规模数据泄露等属于较大事件及以上的,如果在24小时内累计发生5次、影响用户数量大于1万、或可能造成不良社会影响的,《应急响应指南》要求服务提供商立即向主管部门报告。

- 科技伦理

2025年8月,工业和信息化部等部门公开征求对《人工智能科技伦理管理服务办法(试行)》的意见,该办法在《科技伦理审查办法(试行)》的基础上对人工智能科技活动的伦理审查提出了更为细致的要求。例如,该办法明确了人工智能领域伦理审查的重点,涵盖算法偏见、模型鲁棒性、日志管理等方面的针对性要求。同时,该办法还附有《需要开展科技伦理专家复核的人工智能科技活动清单》,若开展清单中人工智能科技活动,在通过初步审查后,应申请开展专家复核。清单目前涉及人机融合系统、舆论引导、高度自主决策系统方面的研发活动,且会根据工作需要动态调整。

(二)执法进入"常态化+专项化"阶段

2025年,人工智能领域的执法从"点状治理"转向"系统整治"。中央网信办的"清朗"系列专项行动成为监管常态,执法范围从算法透明度延伸到人工智能滥用、深度合成、数据安全等领域。

- 专项行动

从2024年底至2025年,中央网信办相继开展了"清朗·网络平台算法典型问题治理"和"清朗·整治AI技术滥用"两项全国性专项行动,全面加强对人工智能及其相关应用的治理力度。

在"清朗·网络平台算法典型问题治理"专项行动中 7,中央网信办联合多部门重点整治同质化推送营造"信息茧房"、违规操纵干预榜单炒作热点、盲目追求利益侵害新就业形态劳动者权益、利用算法实施大数据"杀熟"、算法向上向善服务缺失侵害用户合法权益等重点问题。

此外,中央网信办也同期开展了"清朗·整治AI技术滥用"专项行动 8。该专项行动分为两个阶段:第一阶段聚焦于人工智能技术的源头治理,包括整治未经备案的模型及违规功能、管控违规产品教程和相关商品、审查企业在训练语料管理、内容安全、深度合成内容标识、医疗、金融及未成年人等重点领域的安全控制等方面的义务落实情况。第二阶段重点关注人工智能技术的使用,整治利用人工智能制作发布谣言、发布不实信息、发布色情低俗内容、假冒他人实施侵权违法行为、从事网络水军活动等行为,同时关注人工智能产品服务和应用程序违规以及侵害未成年人权益等问题。

- 地方的执法行动

在中央网信办开展人工智能专项治理活动的背景下,地方层面的执法实践也同步展开。例如,上海市委网信办指导小红书、哔哩哔哩、拼多多等15家重点网站平台,集中清理未经授权的人脸或人声克隆编辑、未备案等违规人工智能产品、商品及相关营销、炒作、推广、教程信息。截止2025年6月,在上海市委网信办的指导下,各重点网站和人工智能平台共拦截清理相关违法违规信息82万余条,处置违规账号1400余个,下线违规智能体2700余个,成效显著。 9

从现有案例来看,全国各地的行政处罚主要集中在内容安全管理和备案登记两大方面。在内容安全方面,2025年6月,筑梦岛APP等人工智能聊天软件因虚拟角色互动生成低俗内容,被上海市网信办约谈,要求平台立即整改,完善内容审核机制,并强化涉及未成年人不良信息的识别与清理。 10在备案登记方面,2024年7月,"灵象智问AI"和"重庆哨兵拓展迷"等网站未完成安全评估和大模型备案,违规提供生成式人工智能服务,被重庆网信部门依法约谈并责令停止相关服务。 11

总体来看,全国及各地方监管机构正逐步形成常态化、分层次的人工智能监管格局,推动人工智能服务进入更加规范和可持续的发展阶段。

(三)司法实践热点总结

虽然当前人工智能模型与应用层出不穷,但近期司法实践中与人工智能相关的案件类型相对集中,主要涉及知识产权及人格权领域的争议。

- 生成式人工智能应用使用未经授权素材的侵权责任

在人工智能应用的开发或运营过程中,如使用未经授权的素材,可能构成侵权。在宋某某诉南京某科技公司案中,被告系人工智能视频换脸类微信小程序的运营方,未经许可,将原告在社交平台发布的短视频作为"AI换脸"模板提供给付费会员下载使用。法院认为涉案短视频的内容体现了原告的个性化创作与编排,具有一定独创性,属于著作权法保护的视听作品。虽然被告辩称系用户自行上传视频,但法院认为平台方对用户上传内容负有基本审核义务,被告未尽审查责任,构成侵权。 12

- 人工智能生成内容的侵权认定

人工智能直接生成的内容亦可能引发侵权纠纷。除我们在去年文章中提及到的广州互联网法院审理的"AIGC平台侵权"第一案外,北京互联网法院发布的人工智能典型案例——李某某诉某文化传媒有限公司网络侵权责任纠纷案,亦具有代表性。在该案中,被告网店经营者擅自使用原告李某某的公开视频,并配以高度近似的AI合成声音,为其销售的图书进行宣传推广。原告认为被告未经许可使用其肖像及AI合成声音,侵犯其肖像权和声音权。法院经审理认为,涉案AI合成声音在音色、语调、发音风格等方面与原告声音高度一致,且结合含有原告肖像的宣传视频,足以使公众将该视频内容与原告建立联系,该AI合成声音应受原告声音权益保护。故被告未经授权使用,构成侵权。尽管视频由被告委托的带货主播发布,但被告对该行为具有审核能力与管理义务,应与主播承担连带侵权责任。 13

- AI生成内容侵权与不正当竞争

企业在提供生成式人工智能技术服务过程中,是否会因用户通过平台生成和传播的侵权内容而构成不正当竞争,也是近年来司法实践中备受关注的热点问题。

在上海新创华文化发展有限公司诉杭州某智能科技有限公司案中,被告通过其运营的应用平台向公众提供包括图生图、模型在线训练等功能的服务。有用户通过上传奥特曼图片训练出奥特曼生图模型,供其他用户生成与奥特曼形象高度相似的图片。这些用户生成的模型和图片在平台上广泛传播,原告作为权利人认为,被告侵犯了其作品的信息网络传播权,并构成不正当竞争。 14

法院审理认为,被告虽非网络内容的直接提供者,不构成直接侵权,但在明知平台可能存在侵权内容且从平台运营中获利的情况下,未尽合理注意义务,主观上存在过错,构成帮助侵权行为。同时,法院指出,被告提供的模型属于技术中立的工具,其服务本身并非以损害竞争秩序或获取不当利益为目的,也未违反诚实信用原则或商业道德,平台的商业模式未对市场秩序造成实质性扰乱,因此不构成不正当竞争。

总体来看,人工智能技术在推动内容创作与商业创新的同时,也带来了前所未有的法律挑战。司法实践正逐步探索在"技术中立"与"责任承担"之间的平衡路径。一方面,法院普遍要求平台运营者或人工智能服务提供者履行合理的审查、提示义务,以防止技术被滥用;另一方面,法院也在尊重技术创新、避免过度规制的原则下,谨慎界定其责任边界。

二、重点合规义务的问答

如上文所述,中国人工智能监管体系正处于持续完善阶段,在立法、执法及司法等多个层面逐步形成系统化的监管框架。为便于理解,本文对其中的重点合规事项进行了归纳梳理,并以Q&A形式予以呈现。

(一)内容标识

《内容标识办法》已成为中国人工智能监管制度中的第四部部门规章,内容标识义务也逐步得到了各行各业的重视。以下是我们对于内容标识义务的简要解读:

- 什么情况下需要添加内容标识?

- 企业该如何添加内容标识?

对于显式标识,《内容标识办法》和GB 45438-2025《网络安全技术 人工智能生成合成内容标识方法》的要求总结如下:

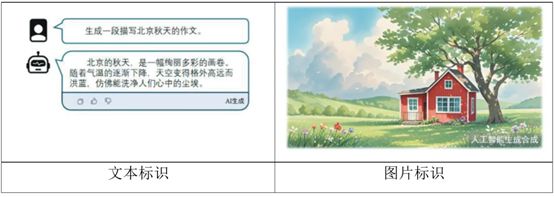

GB 45438-2025《网络安全技术 人工智能生成合成内容标识方法》还在附录C中提供各类场景的示例,例如:

对于隐式标识,服务提供者应在生成合成内容的文件元数据中添加生成合成内容属性信息、服务提供者名称或者编码、内容编号等制作要素信息。

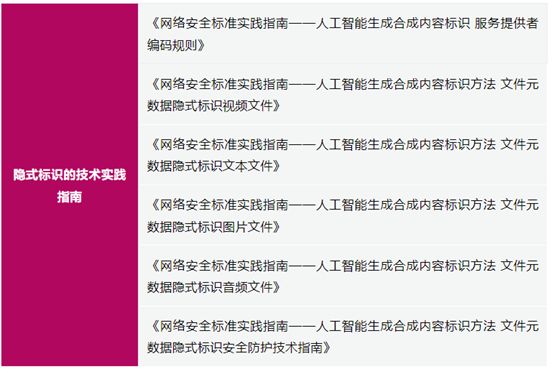

监管者也发布了发布了多项技术指南,提供了各类场景下隐式标识的范例:

- 内容发布平台有什么特殊的义务要求吗?

对于提供内容传播服务的服务提供者(如UGC视频平台、社交平台等),《内容标识办法》也要求其核验所传播的内容文件的隐式标识,并对已声明为生成合成的内容或疑似生产合成的内容添加显著的提示标识。

- 企业能否向用户提供没有添加显式标识的生成合成内容?

有些情况下,显式标识可能会影响生成合成内容的体验和效果,例如用户使用第三方AI服务生成了商业宣传海报。此时,用户会希望获取到没有添加标识的图片。对此,《内容标识办法》允许企业在通过用户协议明确用户的标识义务和使用责任后,提供不含显式标识的生成合成内容,并依法留存申请用户的信息等相关日志不少于六个月。

- 内容标识是否仅是监管要求的合规义务?

在司法实践中,企业是否履行了内容标识义务也成为了判断其在生成合成内容侵权的场景下,是否尽到了注意义务的裁判标准之一。例如,在我们在去年文章中提及到的广州互联网法院审理的"AIGC平台侵权"中,由于案涉人工智能平台未对生成合成内容添加显著标识,同时未设置投诉举报机制、未提供潜在风险提示,广州互联网法院最终认为,该平台未尽到合理的注意义务,应对侵权行为承担相应的赔偿责任。

(二)算法规则公示

20224年11月12日,网信办、工信部、公安部、市场监督管理总局联合发布了《关于开展"清朗·网络平台算法典型问题治理"专项行动的通知》(以下简称"《算法治理专项行动通知》")。该通知罗列了与算法推荐服务相关的待重点整治的六大问题,并明确将公示算法原理、提升算法规则透明度列为其中一项关键的解决措施。 15

- 现行法律法规要求如何进行算法规则公示?

根据《算法推荐规定》第十六条,算法推荐服务提供者应当以适当方式公示算法推荐服务的基本原理、目的意图和主要运行机制等。《算法治理专项行动通知》在明确算法问题整治工作目标时,要求应确保以简单、清晰、可理解的方式公示算法规则。

- 应该如何公示算法规则?

虽然现行法律法规并没有细化算法规则公示的要求,但2025年8月,在北京市网信办的指导下,多家企业分批完成了算法规则公示工作,通过适当的方式公示了算法推荐服务的基本原理、目的意图、主要运行机制等内容,进一步落实对用户知情权的保障。

目前公示算法规则的形式主要有两种,包括(1)通过专门的网页就算法推荐服务提供者适用的算法进行公示。以抖音 16、美团17为例,其在官网设有专门的信息公开页面已对相应内容进行公示,除文字说明外,其还通过图片、数学公式、模型结构等形式详细介绍了推荐算法运行的基本原理,以及相关平台自身推荐算法的运行逻辑与运行目的。(2)在隐私政策中增设相关章节对适用的推荐算法规则进行公示。以瓜子二手车 18、陌陌[19]为例,其在自身的隐私政策中以简明的文字对适用的推荐算法原理、应用场景以及运行机制进行了直观的说明。

我们理解这均是合规可行的算法规则公示方案,各算法推荐服务提供者可根据自身适用的推荐算法数量、算法原理或运行逻辑的复杂程度,通过适当的方式完成公示义务。

- 不公示算法规则会受到怎样的处罚?

根据《算法推荐规定》第三十一条规定,算法推荐服务提供者违反第十六条,未公示算法规则的,可能会被警告、通报批评,责令限期改正;拒不改正或者情节严重的,责令暂停信息更新,并处一万元以上十万元以下罚款。我们理解,现阶段相关监管部门还在逐步推进落实算法规则公示工作,因此目前还没有相应的处罚案例。但前述规则已为监管部门明确了执法依据,后续待算法推荐服务提供者与消费者普遍具备算法规则公示意识后,监管机构亦存在执法可能。

(三)算法与人工智能备案

如我们在《中国人工智能法立法指南》中所述,"具有舆论属性或社会动员能力"的服务提供者需要完成算法备案和大模型备案。我们将结合实务经验,回答一些实务中大家比较关心的问题。

- 如果企业仅在内部使用人工智能服务,是否需要备案?

实践中,如果未向不特定的公众提供人工智能服务,则原则上不会被视为具有"具有舆论属性或社会动员能力"。因此,如果企业仅向内部员工提供人工智能产品,且人工智能产品生成的内容也仅在企业内部使用,则不需要进行算法备案和大模型备案。例如,某游戏公司的员工使用AI绘图工具制作游戏美术素材并使用在游戏中,一般无需进行算法备案和大模型备案。

- 企业通过API接口调用第三方大模型能力,并向外提供人工智能服务,是否需要完成大模型备案?

根据各地网信办的通知,对通过API接口或其他方式直接调用已备案大模型能力的生成式人工智能应用或功能,可以不进行大模型备案,而是由地方省级网信办进行大模型登记。大模型登记所需要的材料和程序相较于备案而言略有简化。企业在获得登记编号后,可直接上线提供服务。

需要注意的是,虽然这种情况下,企业被豁免了大模型备案的义务,但是企业还是需要履行算法备案义务。

- 备案需要准备什么样的材料?

算法备案:企业需要通过"互联网信息服务算法备案系统"填报服务提供者的名称、服务形式、应用领域、算法类型、算法自评估报告、拟公示内容等信息。此外,企业还需要提交公司内部的算法相关制度、《落实算法安全主体责任基本情况》、《算法安全自评估报告》和《算法拟公示内容》。

大模型备案:企业通常需要提交《大模型上线备案申请表》《安全自评估报告》《模型服务协议》《语料标注规则》《关键词拦截列表》《评估测试题集》。此外,企业还需要提供API接口和虚拟测试账号供网信办审核人员进行测试。

- 未履行备案义务会有什么后果?

根据《算法推荐规定》第三十一条规定,未履行备案义务的服务提供者会被给予警告、通报批评,责令限期改正;拒不改正或者情节严重的,还会被责令暂停信息更新,并处一万元以上十万元以下罚款。

实践中,我们注意到"清朗·整治AI技术滥用"专项行动的第一阶段将未备案的违规人工智能产品作为了整治的重点之一。在行动中,各地方监管部门排查了属地企业的备案与登记情况,并督导未履行义务的企业限期完成备案(登记)。此外,各地方监管部门在日常监管过程中也开始对未备案的人工智能产品采取了执法措施。例如,上海网信办对3款未履行备案或登记程序提供服务且存在风险的应用进行了依法约谈并给予行政处罚; 20浙江网信办责令移动应用程序分发平台下架某款未进行安全评估的AI换脸类App。

(四)个人信息保护

《算法推荐管理规定》《深度合成规定》及《AIGC管理办法》等人工智能领域的新近立法,确立了人工智能活动的合规新要求。由于在提供或使用生成式人工智能服务的过程中往往涉及个人信息处理,因此仍需严格遵守《个人信息保护法》等相关法律规定。

- 目前人工智能领域的立法是否涉及特殊的个人信息保护要求?

《算法推荐管理规定》《深度合成规定》及《AIGC管理办法》均是在《网络安全法》《数据安全法》《个人信息保护法》等基础性数据合规法律框架下制定的。其中根据《深度合成规定》第十四条,深度合成服务提供者和技术支持者提供人脸、人声等生物识别信息编辑功能的,应当提示深度合成服务使用者依法告知被编辑的个人,并取得其单独同意。

除此之外,这些人工智能专项立法并未针对人工智能领域制定特殊的、体系化的个人信息保护要求,但均要求在提供算法推荐、深度合成或生成式人工智能服务时遵守现有的个人信息保护规定。具体而言,在模型训练阶段,如训练数据涉及个人信息,应当依法取得个人同意或具备其他合法处理依据,并履行相应的个人信息保护义务; 21在对外提供服务阶段,如涉及个人信息处理,服务提供者应作为个人信息处理者承担相应的法律责任,包括依法受理并处理个人查阅、复制、更正、补充、删除其个人信息的请求等。 22

- 有无生成式人工智能服务提供者因未尽到个人信息保护义务而遭受行政处罚?

在上海网信办于2025年开展的个人信息权益保护专项执法行动中, 23网信办发现某网站在未取得被编辑个人同意的情况下,克隆其声纹信息并进行语音合成提供给其他用户使用,该行为违反了《个人信息保护法》《深度合成办法》中的相关合规要求,网信办因此责令该网站运营方进行全面整改。

尽管通报中未明确指出该网站违反的具体法律条款,但从合规角度理解,声纹信息属于生物识别信息,构成《个人信息保护法》所规定的敏感个人信息。依据该法的要求,处理敏感个人信息应当取得个人的单独同意。

此外,公安网安部门在"护网2025"专项工作中发现 24,某主营业务为对外提供人工智能模型训练基础数据(算料)的科技有限公司,在处理人脸等生物识别类敏感个人信息前,未按《个人信息保护法》有关规定进行个人信息保护影响评估。属地公安机关依据《个人信息保护法》规定,对该公司依法予以行政处罚,并责令整改。

- 生成式人工智能服务提供者何时需要开展个人信息保护影响评估?

根据《个人信息保护法》第五十五条规定,存在下述情形的,个人信息处理者应当进行事前个人信息保护影响评估,包括(1)处理敏感个人信息;(2)利用个人信息进行自动化决策;(3)委托处理个人信息、向其他个人信息处理者提供个人信息、公开个人信息;(4)向境外提供个人信息;(5)其他对个人权益有重大影响的个人信息处理活动。

在模型训练阶段,评估情形可能包括使用含有敏感个人信息的数据进行模型训练,或委托第三方对训练数据中包含的个人信息进行标注、预处理、预训练等活动。在服务提供阶段,评估情形可能涉及通过算法向用户推送个性化内容、基于个人特征进行自动化推荐,或调用、依赖境外大模型向用户提供服务的情况。

总体而言,在模型训练、服务提供、数据共享及跨境传输等全生命周期环节中,生成式人工智能服务提供者应当结合自身业务实际,识别触发评估义务的具体场景,并依法开展个人信息保护影响评估。

- 生成式人工智能服务提供者应如何开展个人信息保护影响评估?

根据《个人信息保护法》第五十六条规定,个人信息保护影响评估应包括下述内容:(1)个人信息的处理目的、处理方式等是否合法、正当、必要;(2)对个人权益的影响及安全风险;(3)所采取的保护措施是否合法、有效并与风险程度相适应。同时,个人信息保护影响评估报告和处理情况记录应当至少保存三年。

除向境外提供个人信息外,目前法律法规尚未对其他情形下的评估标准作出具体规定。因此,我们理解,企业可结合自身履行个人信息保护义务的实际需求,依据上述评估要点,自主设计符合业务特点的评估项目与流程。

如前所述,生成式人工智能服务在模型训练、服务提供、数据共享及跨境传输等全生命周期中均可能触发评估义务。因此,我们建议企业将个人信息保护影响评估纳入产品的研发、测试及上线管理流程中,既可履行法定合规要求,也有助于提前识别和防范潜在风险。此外,在出现重大业务调整、用户规模显著增长等可能对个人权益产生重大影响的情形下,企业应及时重新开展评估,识别新增风险并制定相应的应对措施。

- 目前有无涉及生成式人工智能服务提供者侵犯个人信息权益的民事案件?

在廖某诉某科技文化有限公司网络侵权责任纠纷案中,被告是一款AI换脸应用的运营方,在未获得原告授权的情况下,利用算法将原告在社交平台发布的短视频制作为AI换脸模板,以供用户付费使用。原告认为被告的行为侵犯了其肖像权与个人信息权益,遂起诉至法院。

法院认为,涉案AI换脸模板通过技术手段替换了原告短视频中的肖像,一般公众无法依据替换后的视频识别出原告身份,且被告将该模板提供他人使用的行为亦未构成对原告肖像的丑化或污损,因此不构成对肖像权的侵害。但法院同时指出,被告在制作换脸视频模板过程中,涉及对原告个人信息的收集、处理和分析,而该等处理行为并未取得原告的同意,违反了《个人信息保护法》的相关规定,构成对原告个人信息权益的侵害。 25

Footnotes

1 参见新闻:https://mp.weixin.qq.com/s/56G3L1orPzcTApvScQmhIw

2 参见:https://mp.weixin.qq.com/s/YdBVE3UsaGCyDyFC-xxSkw

3 全称是Guidelines on measures to ensure a high level of privacy, safety and security for minors online, pursuant to Article 28(4) of Regulation (EU) 2022/2065 (Digital Services Act),全文参见:https://eur-lex.europa.eu/legal-content/EN/TXT/?uri=OJ:C_202505519

4 参见:https://www.ftc.gov/news-events/news/press-releases/2025/09/ftc-launches-inquiry-ai-chatbots-acting-companions

5 https://www.cse.edu.cn/index/detail.html?category=148&id=4242

6 https://mp.weixin.qq.com/s/PXm7Ma0-b--8hinRLX1P9A

7 https://www.gov.cn/zhengce/zhengceku/202411/content_6989143.htm

8 https://news.cctv.cn/2025/04/30/ARTIve3Lc4yHTdIpF23PQL1A250430.shtml

9 https://mp.weixin.qq.com/s/qmfe8tiUlXJDnt525ucA-Q

10 https://mp.weixin.qq.com/s/X9cFX9Eaw0BLbMdxV9GbKg

11 https://mp.weixin.qq.com/s/yr79-J8iuf5O5TGbc1KxWg

12 (2023)苏01民终10264号,2023年度南京法院知识产权十大案例,https://mp.weixin.qq.com/s/XAz_ntU-sp7s6KpDFIDTkg

13 2025年度北京互联网法院涉人工智能典型案例之案例三,https://mp.weixin.qq.com/s/E-9ECMK1t8znrXGAMR1Arg

14(2024)浙01民终10332号,2024年度浙江法院知识产权保护典型案例之案例一,https://mp.weixin.qq.com/s/7s0ycNZL14_GL6jf4KVB7Q

15 https://www.gov.cn/zhengce/zhengceku/202411/content_6989143.htm

16 https://95152.douyin.com/article/15358?enter_from=channel_page&channel=home

17 https://www.meituan.com/newsroom/algorithm-transparency

18 https://image-pub.guazistatic.com/qnbdp1066x300541bb8e9f48f8b37f51d915cb38d11755066856.pdf

19 https://m.immomo.com/inc/privacy_policy.html

20 https://mp.weixin.qq.com/s/qmfe8tiUlXJDnt525ucA-Q。

21 如《深度合成规定》第十四条第一款,《AIGC管理办法》第七条。

22 如《AIGC管理办法》第九条、第十一条。

23 https://mp.weixin.qq.com/s/kWsWPXX34SdVo8_NYnqvhw

24 https://mp.weixin.qq.com/s/JS2hSkgt7-xurIY_6skMqg

25 参见:https://mp.weixin.qq.com/s/E-9ECMK1t8znrXGAMR1Arg,案例四

The content of this article is intended to provide a general guide to the subject matter. Specialist advice should be sought about your specific circumstances.